인텔리시스, 노코드 기반 RAG 구축 솔루션 ‘레그빌더’ 출시

노코드 기반으로 LLM 활용 서비스 개발에 필수인 검색증강생성 자동 구축

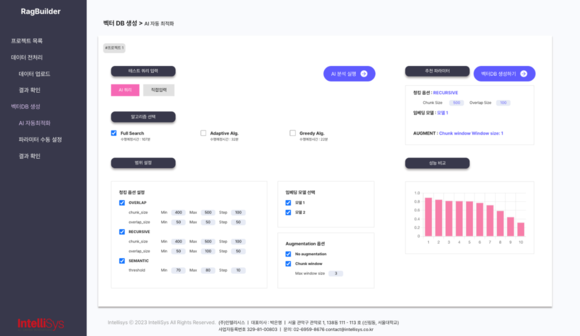

▲레그빌더 화면 / 사진=인텔리시스

AX 전문기업 인텔리시스(대표 박은영·이상구)는 거대언어모델(LLM)을 활용한 서비스 개발에 필수적인 검생증강생성(RAG)을 노코드 기반으로 자동 구축할 수 있는 솔루션 ‘레그빌더(Rag Builder)’를 출시했다고 23일 밝혔다.

RAG는 LLM이 답변을 생성하기 전에 사전 학습한 데이터뿐만 아니라 기업 내의 신뢰할 수 있는 주요 정보를 참조하도록 하는 프로세스EK. 막대한 리소스가 소요되는 학습과정을 거치지 않고도 LLM 서비스에서 치명적인 할루시네이션(환각)을 완화시키고, 정확한 지식 활용으로 답변 투명성을 제공해 최근 생성형 AI 분야에서 주목받는 기술이다.

이상구 인텔리시스 대표(서울대 컴퓨터공학부 교수)는 “RAG는 정보자원을 지식 단위로 분할하는 청킹부터 각 청크(지식 단위)를 벡터화하는 임베딩, 사용자 질문에 근거가 되는 청크를 찾아내는 의미검색, 이를 이용해 정확한 답변을 생성하게 하는 증강생성에 이르는 여러 단계의 파이프라인을 거치는데, 각각의 단계에서 어떤 기술적 전략을 선택하는지에 따라 답변의 정확도가 크게 차이가 난다”고 말했다.

이 대표는 또 “현재는 RAG 파이프라인 각 단계에서 사람이 직접 전략을 설정하고 시행착오를 거쳐 최적화 기술 전략을 찾아내는데 수개월이 소요되고 있어 RAG 구축이 LLM 서비스 개발에 병목이 되고 있다”며 “인텔리시스는 RAG 파이프라인 전체의 최적화 과정을 AI로 자동화해 사람의 개입 없이 RAG를 구축할 수 있다”고 덧붙였다.

인텔리시스에 따르면, 레그빌더는 AI가 기업의 지식 자원을 분석해 사용자의 예상 질문을 도출하고, 예상 질문에 최적인 RAG 파이프라인을 정의하고 실행해 기존 방식 대비 구축 시간은 1/300로 감소하고 성능은 2.2배 높이는 결과를 보였다.

이상구 대표는 “생성형 AI 시장의 패러다임이 파운데이션 모델 중심에서 혁신적인 서비스 개발로 전환되고 있다. 글로벌 시장에서 RAG 기술이 이미 세분화, 정교화되고 있는 반면, 국내에서는 단순한 검색기술 정도로 받아들여지고 있다”며 “인텔리시스는 글로벌 최초로 RAG 구축을 자동화하는 레그빌더를 시작으로 높은 성능을 기반으로 한 혁신적인 LLM 서비스 빌더로 자리매김하겠다”고 말했다.

강동식 기자 lavita@datanews.co.kr

[ⓒ데이터저널리즘의 중심 데이터뉴스 - 무단전재 & 재배포 금지]